.

CFM regulamenta o uso de IA na medicina — e o prazo para adequação já está correndo

O Conselho Federal de Medicina publicou em 27 de fevereiro de 2026 a Resolução nº 2.454/2026, que define as regras para o uso de inteligência artificial na prática médica no Brasil. A norma entra em vigor em 180 dias — o que significa que médicos, hospitais, clínicas e empresas de tecnologia em saúde têm até aproximadamente agosto ou setembro de 2026 para se adequar.

A regra central: IA apoia, não decide. A resolução é clara: nenhum sistema de inteligência artificial pode substituir o julgamento médico.

Diagnósticos, tratamentos e prognósticos continuam sendo responsabilidade exclusiva do médico — que pode aceitar ou rejeitar qualquer recomendação gerada por IA, e tem o direito de recusar ferramentas sem validação científica ou certificação regulatória.

Classificação de risco obrigatória: Toda instituição que usa ou desenvolve IA deve classificar seus sistemas em quatro categorias: baixo risco (ex: agendamento e suporte administrativo), médio risco (suporte clínico em contextos não críticos), alto risco (diagnóstico, prescrição, contextos críticos) e inaceitável (sistemas que substituem a decisão médica ou violam direitos fundamentais — proibidos). Os critérios de classificação incluem a criticidade do contexto de uso, a finalidade, o nível de autonomia do sistema e o impacto potencial sobre os direitos dos pacientes.

O que as empresas e instituições precisam fazer nos próximos 180 dias: Primeiro, mapear todos os sistemas de IA em uso — desde ferramentas de triagem até algoritmos de apoio diagnóstico. Segundo, realizar a avaliação preliminar de risco de cada sistema e documentar os critérios utilizados. Terceiro, estruturar uma governança de IA sob coordenação médica, vinculada à diretoria técnica, com competência para implementar regras, prevenir vieses e gerir o ciclo de vida das ferramentas. Quarto, implementar mecanismos de auditoria e monitoramento contínuo proporcionais ao nível de risco de cada sistema. Quinto, garantir conformidade com a LGPD, especialmente pela sensibilidade dos dados de saúde. Sexto, criar uma política de transparência ao paciente — que tem o direito de ser informado sempre que a IA for usada de forma relevante no seu cuidado. E sétimo, estabelecer um canal interno de tecnovigilância para identificar e reportar falhas às autoridades competentes.

Para empresas de healthtech, o recado é direto: seus produtos precisam ter validação científica, certificação regulatória e documentação de risco — ou os médicos têm o direito expresso de recusá-los.

Sobre o Autor

Adriana Rollo

Diretora de Relações Institucionais da I2AIAdriana Rollo é VP de Relações Institucionais da I2AI, advogada especializada em tecnologia, propriedade intelectual e proteção de dados. Mestre (LL.M) em Propriedade Intelectual pela Queen Mary University of London, hoje lidera grupos de trabalho sobre o Projeto de Lei de Inteligência Artificial no Congresso Nacional.

Leia Também

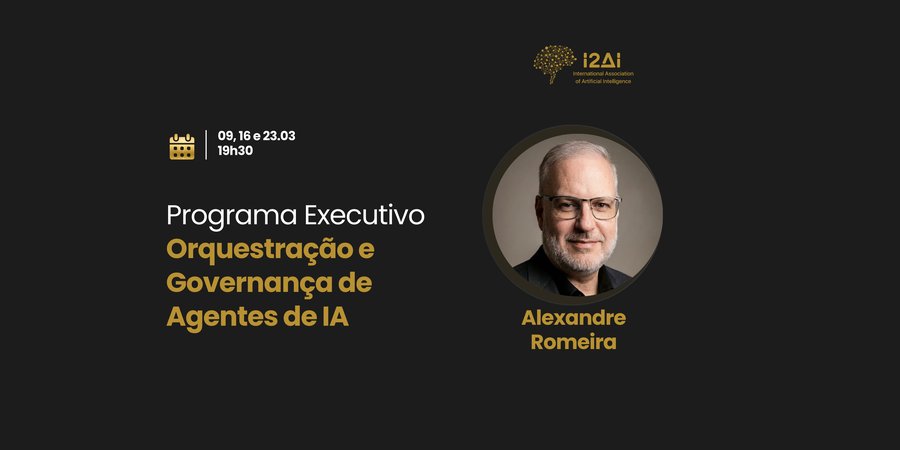

Programa Executivo em Orquestração e Governança de Agentes de IA

Agentes de IA estão deixando de ser experimentos isolados para se tornarem componentes críticos de operação. Para organizações reguladas e de alta responsabilidade, o desafio não é apenas “ter agentes”,